V istom vidieckom prostredí sa odohral príbeh o neobyčajnom zlodejovi - zajacovi, ktorý si obľúbil kradnutie kapusty. Hoci sa na prvý pohľad môže zdať, že ide o drobnú nepríjemnosť, tento príbeh poukazuje na širšie problémy spojené so zabezpečením a odhaľovaním nelegálnej činnosti.

Problém s nelegálnym stieraním dát

V digitálnom svete sa stretávame s podobnými výzvami, kde nelegálne stieranie (scraping) dát predstavuje značný problém. Tieto aktivity, hoci na individuálnej úrovni môžu byť zanedbateľné, pri masovom vykonávaní zvyšujú náklady a komplikujú prístup k informáciám. Ide o situáciu, kde sa na prvý pohľad nevýznamná záťaž stáva významným problémom v rozsahu.

The idea is that at individual scales the additional load is ignorable, but at mass scraper levels it adds up and makes scraping much more expensive.

Hľadanie efektívnych riešení

Snaha o riešenie tohto problému vedie k vývoju pokročilých metód, ktoré sa zameriavajú na identifikáciu a odlíšenie legitímnych používateľov od automatizovaných systémov. Jedným z prístupov je využitie "dôkazov práce" (proof of work), ktoré majú za úlohu overiť, či používateľ nie je robot.

Ultimately, this is a placeholder solution so that more time can be spent on fingerprinting and identifying headless browsers (EG: via how they do font rendering) so that the challenge proof of work page doesn't need to be presented to users that are much more likely to be legitimate.

Technologické obmedzenia a výzvy

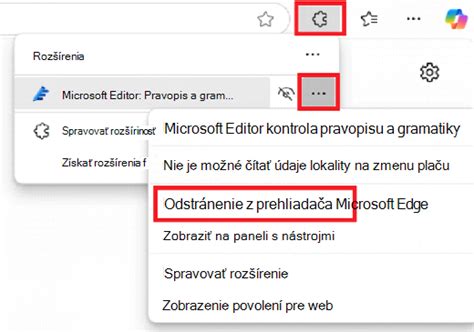

Pri implementácii takýchto bezpečnostných opatrení sa však objavujú aj technologické prekážky. Niektoré moderné funkcie JavaScriptu, ktoré sú nevyhnutné pre tieto systémy, môžu byť blokované rozšíreniami prehliadačov, ako je napríklad JShelter.

Please note that Anubis requires the use of modern JavaScript features that plugins like JShelter will disable.

Tento konflikt medzi bezpečnostnými mechanizmami a nástrojmi na ochranu súkromia používateľov vytvára komplexnú situáciu, ktorá si vyžaduje neustále inovácie a hľadanie rovnováhy.

Budúcnosť zabezpečenia proti stieraniu dát

Vývoj smeruje k sofistikovanejším metódam detekcie, ktoré sa nespoliehajú len na jednoduché "dôkazy práce". Dôraz sa kladie na "odfukovanie" (fingerprinting) a identifikáciu bezhlavých prehliadačov prostredníctvom analýzy ich správania, napríklad ako spracúvajú vykresľovanie fontov.

The idea is that at individual scales the additional load is ignorable, but at mass scraper levels it adds up and makes scraping much more expensive.

Ultimately, this is a placeholder solution so that more time can be spent on fingerprinting and identifying headless browsers (EG: via how they do font rendering) so that the challenge proof of work page doesn't need to be presented to users that are much more likely to be legitimate.

Please note that Anubis requires the use of modern JavaScript features that plugins like JShelter will disable.